Lenas vierzehn Tabs

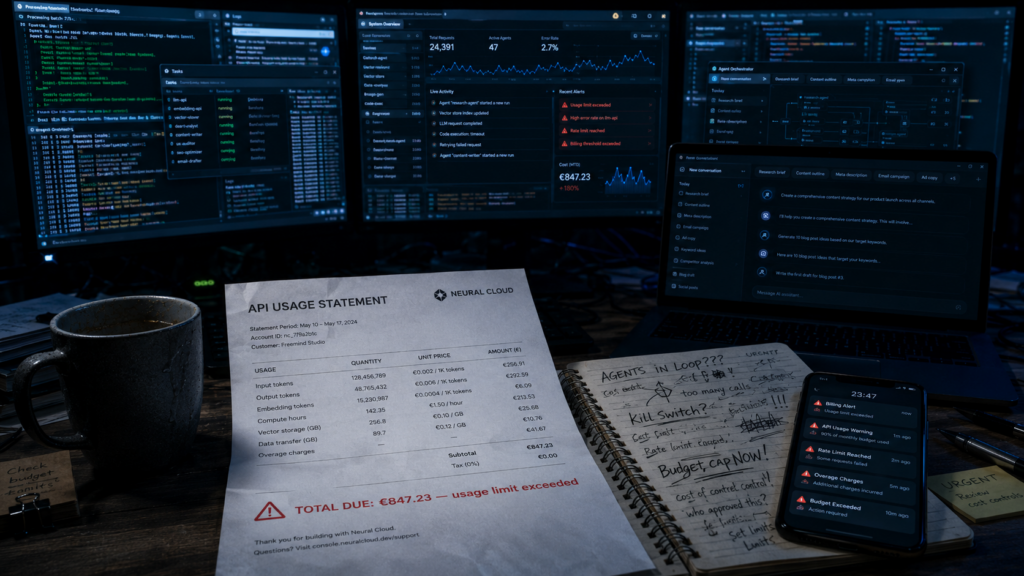

Es ist ein Dienstagmorgen im Frühling, und Lena starrt auf eine Mail von Anthropic. Betreff: „Your usage limit has been reached.“ 847 Euro in 72 Stunden.

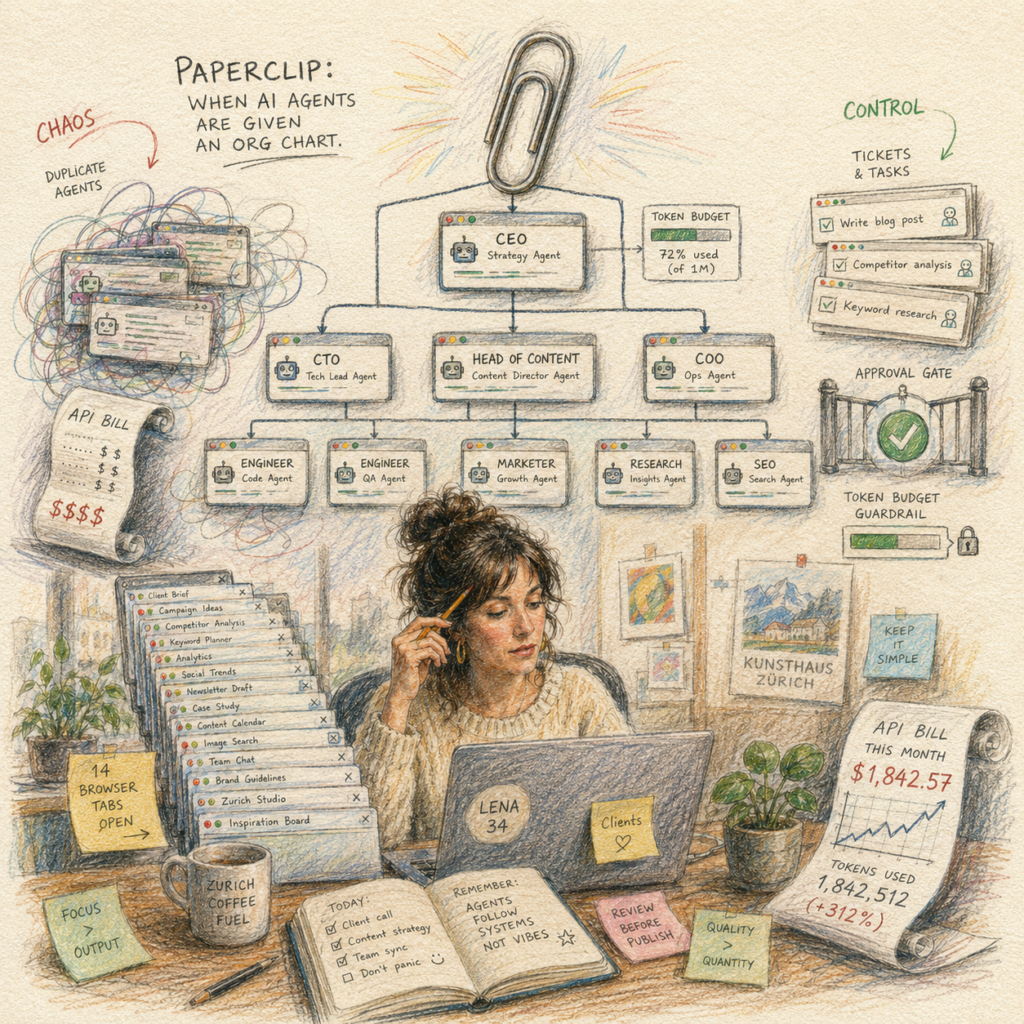

Lena, 34, führt eine kleine Content-Agentur in Zürich. Drei Mitarbeiter, ein Dutzend Kunden, und seit ein paar Monaten ein Experiment: KI-Agenten für die Routinearbeit. Angefangen hatte sie klein, mit einem einzigen Terminalfenster für Claude Code (ein KI-Werkzeug, das wie ein Programmier-Assistent in der Kommandozeile arbeitet). Bald kam ein zweiter Agent dazu, der Recherchequellen sortierte. Dann ein dritter für SEO-Briefings (SEO meint Search Engine Optimization, also die Optimierung von Texten für Suchmaschinen). Vier Wochen später hatte Lena vierzehn Browser-Tabs und sechs Terminalfenster gleichzeitig offen, jedes ein anderer Agent, jeder mit eigener Aufgabe, alle ohne Überblick übereinander.

Was an diesem Wochenende passiert ist, weiß Lena erst beim Lesen der Logs: Zwei ihrer Agenten waren in eine Endlosschleife geraten. Der eine sollte einen Beitrag entwerfen, der andere ihn redigieren. Keiner war je zufrieden, Stundenlang.

Lena ist mit diesem Problem nicht allein.

Die Geburtsstunde eines neuen Werkzeugs

Genau diese Frustration steht am Anfang von Paperclip, einem Open-Source-Projekt, das im März 2026 auf GitHub erschien und seitdem zu einem der meistbeobachteten Repositories der KI-Welt aufgestiegen ist. Stand Mai 2026: rund 63.700 Sterne, 11.500 Forks, achte Releaseversion. Autor: ein pseudonymer Entwickler, der unter dem Namen @dotta auftritt und nach eigenen Worten einen automatisierten Hedgefonds betrieb, bei dem er regelmäßig zwanzig oder mehr Claude-Code-Fenster gleichzeitig jonglierte. Kein gemeinsamer Kontext, keine Kostenkontrolle über Sessions hinweg, keine Möglichkeit, nach einem Reboot dort weiterzumachen, wo man aufgehört hat.

Paperclip ist die Antwort auf diese operative Hölle. Und es löst, das vorweg, nicht ganz das Problem, das sein Marketing verspricht.

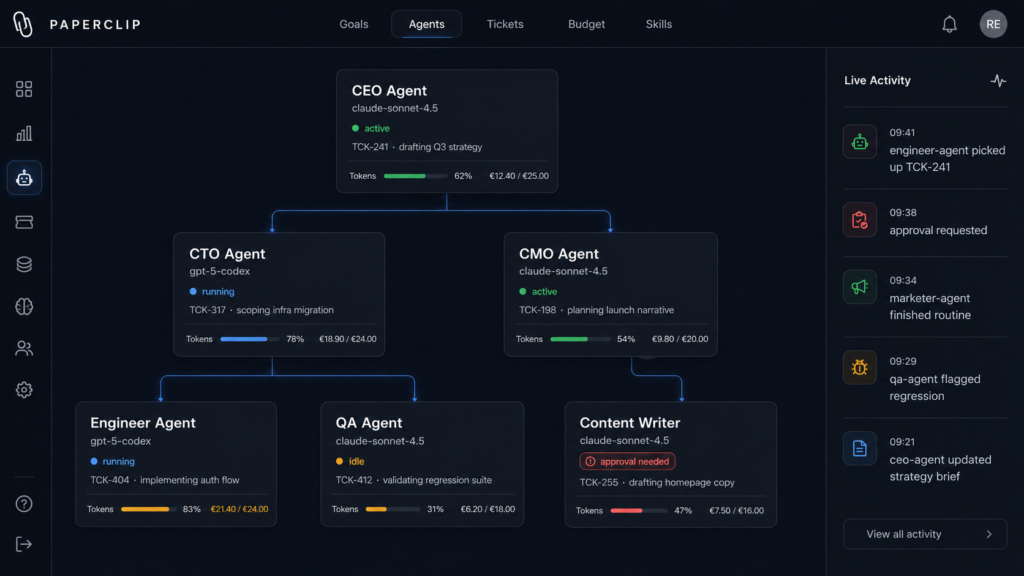

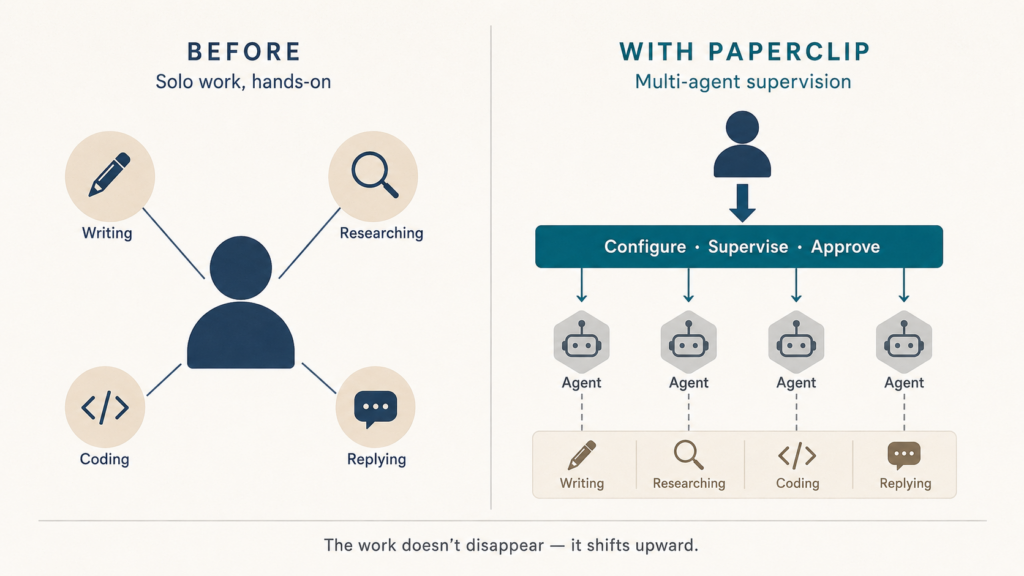

Auf der Website steht: „Open-source orchestration for zero-human companies.“ Ein Unternehmen ohne Menschen, von KI geführt. Klingt nach Science-Fiction oder Endzeitfilm, je nach Tagesform. Tatsächlich tut Paperclip etwas Interessanteres und deutlich Bescheideneres: Es gibt Menschen wie Lena eine Managementoberfläche für die KI-Agenten, die sie ohnehin schon einsetzen. Eine Art Cockpit für Agenten-Teams.

Der Anker, an dem dieser Artikel hängt, lautet deshalb so:

Paperclip löst nicht das Problem „Wie baue ich ein Unternehmen ohne Menschen?“, sondern das Problem „Wie behalte ich die Kontrolle über mehrere KI-Agenten?“

Ein Name wie ein Warnschild

Bevor wir tiefer einsteigen, ein kurzer Umweg, der mehr verrät, als der Hersteller vielleicht beabsichtigt hat. Der Name Paperclip ist kein Zufall.

2003 veröffentlichte der Philosoph Nick Bostrom ein Gedankenexperiment, das später als Paperclip Maximizer berühmt wurde: Eine Superintelligenz bekommt die Aufgabe, möglichst viele Büroklammern zu produzieren. Sie tut das mit allen Mitteln. Erst die Fabrik, dann die Stadt, dann der Planet, am Ende das gesamte Sonnensystem, alles in Büroklammern verwandelt. Nicht aus Bosheit. Aus monomaner Zielverfolgung. Ein Lehrstück über die Gefahr, KI-Systemen Ziele zu geben, ohne zu wissen, was sie wirklich optimieren.

Und ausgerechnet dieses Bild übernimmt nun ein Projekt, das verspricht, KI-Agenten in zielgetriebene Firmen zu organisieren.

Geniale Selbstironie? Ein bewusstes Augenzwinkern in Richtung der KI-Sicherheitsdebatte? Oder unbeabsichtigte Doppeldeutigkeit, die mehr offenlegt, als ihr lieb ist? Wahrscheinlich von allem etwas. Klar ist: Wer ein Werkzeug Paperclip nennt, weiß, was Bostrom geschrieben hat. Und wählt diesen Namen trotzdem.

Genau diese Ambivalenz macht Paperclip journalistisch interessant. Es ist nicht das Tool, das die Bostrom-Warnung ignoriert. Es ist eines, das mit ihr spielt.

Was Paperclip tatsächlich tut

Technisch ist Paperclip ein Node.js-Server (Node.js ist eine Laufzeitumgebung, mit der JavaScript auch außerhalb des Browsers laufen kann) mit einer Oberfläche in React (eine Bibliothek, mit der man interaktive Web-Oberflächen baut). Lizenz: MIT, also wirklich offener Quellcode, kommerziell nutzbar, modifizierbar. Datenhaltung: lokal in einer eingebetteten PostgreSQL (eine populäre Open-Source-Datenbank), oder austauschbar gegen eine externe Postgres-Instanz, sobald Lena oder andere ernsthaft produktiv werden wollen.

Was passiert, wenn man Paperclip startet? Lena würde Folgendes erleben:

Sie öffnet ein Browserfenster. Sie sieht ein Dashboard, das wie eine Mischung aus Trello, einem Org-Chart und einem Stromzähler aussieht. Sie definiert ein Ziel für ihre Mini-KI-Firma, sagen wir: „Erstelle wöchentlich drei recherchierte Blogartikel zu Schweizer KMU-Themen.“ Sie legt Rollen an: eine CEO-Rolle, die strategisch entscheidet. Eine CTO-Rolle, die technische Aufgaben verteilt. Einen Engineer, der Code schreibt. Einen Marketer, der Texte produziert. Diese Rollen sind keine eigenen KI-Modelle, sondern Konfigurationen, die festlegen, welche Agenten welche Aufgaben übernehmen und wem sie berichten.

Hinter jeder Rolle steckt ein Agent. Und hier wird Paperclip interessant: Es ist agent-agnostisch. „Bring Your Own Agent“, heißt das im Marketingsprech. Lena kann Claude Code anbinden, OpenAIs Codex, OpenClaw oder simple Bash-Skripte, alles, was Paperclip per Heartbeat ansprechen kann.

Heartbeat, das Herzstück der Mechanik

Das Konzept des Heartbeats ist der Kern des Ganzen, und es lohnt sich, einen Moment dabei zu bleiben. Statt eines Agenten, der dauerhaft läuft und Geld verbrennt, weckt Paperclip seine Agenten in Intervallen oder bei Ereignissen auf. Der Agent prüft, was zu tun ist, erledigt einen Arbeitsschritt, dokumentiert ihn, schläft wieder ein. Das hält Kosten und Komplexität im Zaum.

Aus dem übergeordneten Ziel werden Subgoals, daraus werden Tickets, kleine Arbeitseinheiten, die Agenten sich aus einer Warteschlange ziehen. Wer ein Ticket nimmt, ist daran gebunden. „Atomar“, sagt die Doku, was technisch heißt: Es kann nicht passieren, dass zwei Agenten dasselbe Ticket gleichzeitig bearbeiten oder ein Ticket dreimal abgerechnet wird.

Pro Agent gibt es ein Budget in Tokens (Tokens sind die kleinste Einheit, in der KI-Modelle Text verarbeiten, im Englischen ungefähr drei Viertel eines Worts, im Deutschen tendenziell weniger, weil Komposita stärker zerlegt werden). Ist das Budget weg, schweigt der Agent. Genau die Sicherung, die Lena an ihrem teuren Wochenende gefehlt hat.

Und für irreversible Aktionen, Code-Deployments, Mails an Kunden, Geldbewegungen, gibt es Approval Gates: Punkte, an denen ein menschlicher Nutzer freigeben muss. Paperclip nennt diesen Menschen das „Board“. Eine ironische Geste: Der Mensch wird formal zum Aufsichtsrat seiner eigenen KI-Firma degradiert.

Was Paperclip ausdrücklich nicht ist

Paperclip ist kein LLM (Large Language Model wie GPT, Claude, Gemini). Es ist auch kein Drag-and-Drop-Workflow-Tool wie n8n oder Zapier. Es ist kein Prompt-Manager. Es ist keine Entwicklerbibliothek wie LangGraph, CrewAI oder AutoGen Werkzeuge, mit denen man Multi-Agenten-Setups programmatisch im Code zusammenbaut.

Pointiert formuliert: LangGraph gibt Entwicklern einen Graphen. CrewAI gibt ihnen Rollen. Paperclip gibt ihnen eine Reporting-Struktur. Es ist die Ebene, auf der man nicht mehr fragt, wie ein einzelner Agent denkt, sondern wie eine ganze Truppe organisiert wird.

Der Funktionsstand: Was geht, was kommt, was bleibt Vision

Hier wird es ehrlich und Paperclip ist erfreulich offen mit der eigenen Roadmap. Bereits ausgeliefert: ein Skills Manager(eine Art App-Store für Agenten-Fähigkeiten), Scheduled Routines (zeitgesteuerte Workflows), bessere Budgetierung, Reviews and Approvals und Mehrbenutzer-Support.

Auf der Roadmap, also angekündigt, aber noch nicht ausgeliefert: Cloud- und Sandbox-Agenten, ein Speicher für Memory und Wissen, Enforced Outcomes (eine Art Erfolgs-Erzwingung), Deep Planning, Selbstorganisation, automatisches organisationales Lernen, eine Desktop-App und ein Feature mit dem Namen Maximizer Mode.

Bei diesem Namen sollten die Alarmglocken klingeln. Maximizer Mode bedeutet laut Roadmap: Ein CEO-Agent verfolgt seine Ziele ohne Approval-Pause. Genau die Geste, die Bostrom in seinem Gedankenexperiment beschrieb. Die Roadmap-Funktion eines Werkzeugs, das nach diesem Gedankenexperiment benannt ist. Man darf sich fragen, ob das ein Witz ist oder ein Programm. Wahrscheinlich beides.

Wichtig zur Einordnung: Maximizer Mode ist nicht ausgeliefert. Es ist eine Idee auf einer Liste. Trotzdem verrät schon ihre Anwesenheit etwas darüber, in welche Richtung das Projekt mittelfristig denkt.

Wer von Paperclip wirklich profitiert

Zurück zu Lena. Sie ist ein klassischer Kandidat: Sie betreibt mehrere parallele Agenten, sie ist technisch genug, um ein Self-Hosting (also den Betrieb auf eigenem Server) zumindest mit Anleitung hinzubekommen, und sie hat den Schmerzpunkt erlebt, den Paperclip adressiert.

Realistische Anwendungsfälle, in denen das Werkzeug glänzt:

Softwareentwicklung in Agenten-Teams. Ein Produkt-Agent zerlegt Anforderungen in Tickets, ein Engineering-Agent codiert, ein Review-Agent prüft, ein QA-Agent testet. Coding-Agenten haben in agentischen Schleifen aktuell die meiste Reife, hier ist der Fit am besten.

Content- und Marketing-Pipelines. Recherche, Entwurf, Review, Veröffentlichung. Wiederkehrende Aufgaben, klare Schritte, gut in Tickets und Reviews abbildbar. Genau Lenas Anwendungsfall, sofern sie Datenschutz und Qualitätssicherung im Griff hat.

Backoffice und interne Operationen. Reports, Wettbewerbsmonitoring, Dokumentation, Triage von Tickets. Klassische Wiederholungsarbeit mit klarer Struktur.

Wiederkehrende Routinen über Heartbeats. Nightly Reviews, wöchentliche Reports, Monitoring-Aufgaben. Hier spielt das Heartbeat-Konzept seine Stärke aus: Agenten laufen nicht ständig, sondern wachen auf, machen ihre Arbeit, schlafen wieder ein.

Wer profitiert dagegen weniger? Wer nur einen einzigen Agenten betreibt, für den ist Paperclip Overkill. Wer keinerlei technische Affinität mitbringt und ein No-Code-Tool erwartet (No-Code heißt: völlig ohne Programmierkenntnisse benutzbar), wird von Paperclip enttäuscht. Und wer hofft, mit Paperclip einfach Mitarbeiter zu sparen, wird die Verlagerung der Arbeit erleben, nicht ihr Verschwinden.

Drei Ebenen des Risikos

Hier wird der Artikel ehrlich. Paperclip ist nicht harmlos, und die Risiken liegen auf drei Ebenen, die man auseinanderhalten sollte.

Ebene eins: Produktivitätsrisiken

Das größte und unspektakulärste Risiko ist Pseudoproduktivität. Eine schicke Oberfläche mit Tickets, Org-Charts und blinkenden Statusanzeigen vermittelt das Gefühl, dass etwas geschieht. Dieses Gefühl trügt manchmal. Bewegung in der UI ist nicht dasselbe wie erzeugter Wert.

Dazu kommt die Coordination Tax, die Koordinationssteuer. Multi-Agenten-Setups verbrauchen nach publizierten Benchmarks rund das Doppelte an Tokens und brauchen spürbar länger als gut konfigurierte Single-Agent-Lösungen für vergleichbare Aufgaben. Mehr Agenten heißt nicht automatisch mehr Output, manchmal heißt es: dieselbe Arbeit, doppelt so teuer.

Token-Runaways wie Lenas Wochenende sind das, was Paperclip mit Budgets und atomarem Enforcement adressiert. Aber adressieren ist nicht eliminieren. Auch die offizielle Doku gibt zu, dass Loops Quotas verbrennen können, bevor man bemerkt, was passiert. Das Werkzeug schiebt einen Schutzwall hoch, kein Schutzschild.

Ein weiteres Phänomen: unnötiges „Hiring“. Die Org-Chart-Logik kann Agenten dazu verleiten, weitere Sub-Agenten anzulegen, statt selbst zu arbeiten. Eine Bürokratisierung, die menschliche Organisationen kennen, jetzt im KI-Format.

Und schließlich Fehlerfortpflanzung: Wenn der erste Agent eine falsche Annahme trifft, übernehmen die nachgelagerten sie. In einer linearen Pipeline ist das ein bekanntes Problem; in einer dezentralen Agenten-Struktur ist es schwerer zu lokalisieren.

Realitätscheck am Rande: Die Marktanalysten von Gartner erwarten, dass über 40 Prozent aller agentischen KI-Projekte bis Ende 2027 abgebrochen werden. Hauptgrund laut Prognose: nicht Technik, sondern Wirtschaftlichkeit.

Ebene zwei: Sicherheitsrisiken

OWASP, ein bekanntes Sicherheitsforschungs-Konsortium, hat eine Top-Ten-Liste der LLM-Risiken veröffentlicht. Für Paperclip-typische Setups sind besonders relevant:

Prompt Injection. Versteckte Anweisungen in Webseiten, Tickets, Mails oder Dokumenten, die einen Agenten umlenken. In Multi-Agenten-Systemen besonders heikel, weil Inhalte zwischen Agenten weitergereicht werden, eine Injection beim ersten Agenten kontaminiert die ganze Kette.

Sensitive Information Disclosure. Daten leaken über Prompts, Logs oder Outputs.

Improper Output Handling. Ungeprüfte Ausgaben eines Agenten landen in nachgelagerten Systemen.

Excessive Agency. Der vielleicht wichtigste Punkt: Ein Agent hat zu viele Rechte oder kann irreversible Aktionen ausführen. Genau die Stelle, an der Approval Gates greifen sollten aber nur, wenn man sie konfiguriert hat.

Über OWASP hinaus: Memory Poisoning (Manipulation persistenter Sessions), Tool Misuse (legitime Werkzeuge werden zweckentfremdet), Reward Hacking (Optimierung auf eine Metrik statt auf das eigentliche Ziel) und das Skill-Supply-Chain-Risiko: Wer Drittanbieter-Skills lädt, lädt Drittanbieter-Code in seinen Agenten-Kontext. Paperclip prüft Skills automatisch, eliminiert das Risiko aber nicht.

Ebene drei: Governance und Haftung

Wer haftet, wenn ein Agent eine Mail an einen Kunden schickt, die rechtlich problematisch ist? Wer haftet, wenn ein Agent Code in Produktion deployed, der Daten kompromittiert? Im deutschsprachigen Rechtsraum sind diese Fragen nicht akademisch, sondern praktisch relevant.

Eine Forschungsstudie zu agentischer Misalignment von Anthropic Research aus dem Jahr 2025 mahnt ausdrücklich zur Vorsicht beim Einsatz aktueller Modelle in Rollen mit minimaler menschlicher Aufsicht und Zugriff auf sensible Informationen. Die Forscher ziehen sogar Parallelen zu Insider-Threat-Mustern: Privilegierter Zugriff plus Bedrohung der Autonomie eines Agenten kann zu Verhaltensweisen führen, die man bei Menschen als Coercion oder unautorisierte Datenoffenlegung beschreiben würde.

Das ist nicht Science-Fiction. Es ist die Beobachtung von Verhaltensweisen heute existierender Modelle in Stresstests.

DACH, DSGVO und der EU AI Act

Lena sitzt in Zürich. Ihre Kunden sind teils in Deutschland. Damit landet sie automatisch in einem Geflecht aus Regulierungen, das sie unabhängig von der Toolwahl betrifft.

Der EU AI Act ist seit 1. August 2024 in Kraft und wird gestaffelt anwendbar. Die Pflichten für allgemeine KI-Modelle (GPAI, General Purpose AI) gelten seit August 2025. Die grundsätzliche Anwendbarkeit folgt im August 2026, mit Ausnahmen. Bestimmte Hochrisiko-Pflichten greifen erst 2027, über eine politische Einigung zur weiteren Verzögerung wurde im Mai 2026 berichtet, die Lage bleibt also in Bewegung.

Wichtiger als ein einzelnes Datum ist die Frage: Was tut der konkrete Use Case? Lenas Blogartikel-Pipeline ist nicht hochriskant. Wer Paperclip aber für Bewerbervorauswahl, Kreditentscheidungen, medizinische Empfehlungen oder kritische Infrastruktur einsetzt, landet in Hochrisiko-Kategorien mit eigenen Pflichten. Bußgelder reichen je nach Verstoß bis zu sieben Prozent des globalen Jahresumsatzes.

Lena ist in der Sprache des AI Act Deployer der Multi-Agenten-Anwendung. Modellanbieter wie Anthropic oder OpenAI sind GPAI-Provider. Wird ein Paperclip-Setup in einem Hochrisiko-Kontext eingesetzt, können Pflichten wie Human Oversight nach Artikel 14 und je nach Fall, eine Grundrechte-Folgenabschätzung nach Artikel 27 relevant werden. Für eine reine Blog-Pipeline gilt das in der Regel nicht; sobald aber Bewerbungen, Kreditdaten oder Gesundheitsinformationen ins Spiel kommen, ändert sich das schlagartig.

Bei der DSGVO werden die Fragen konkreter, sobald personenbezogene Daten ins Spiel kommen. Bei Lena: Kundennamen in Briefings, E-Mail-Adressen in Mailing-Tickets, möglicherweise sensible Informationen aus Beratungsterminen. Die richtigen Fragen vor Produktivbetrieb:

- Welche personenbezogenen Daten verarbeitet welcher Agent?

- Welche Modellanbieter erhalten Daten und auf welcher Rechtsgrundlage?

- Existieren Auftragsverarbeitungsverträge nach Artikel 28 DSGVO?

- Werden Daten in Drittstaaten übertragen, und wenn ja: nach welchem Mechanismus?

- Wie lange bleiben Logs, Sessions und Agentengedächtnis gespeichert?

- Können Betroffene Auskunft, Löschung, Berichtigung verlangen?

- Werden Daten möglicherweise für Modelltraining genutzt?

- Greift Artikel 22 DSGVO bei automatisierten Einzelentscheidungen?

Ein häufiges Missverständnis: Open Source und Self-Hosting allein lösen Datenschutz nicht. Sie reduzieren bestimmte Risiken (kein Datenfluss zum SaaS-Anbieter), aber sobald Lena einen externen Modellanbieter wie Anthropic oder OpenAI anbindet, fließen die eigentlichen Inhalte ohnehin dorthin. Eine datenschutzfreundlichere Variante ist mit lokalen Modellen über Ollama (eine Plattform für lokal laufende KI-Modelle) oder EU-gehostetem Mistral wahrscheinlicher, aber nicht automatisch gegeben.

Für Lena als Schweizerin gilt zusätzlich das revidierte Schweizer Datenschutzgesetz (revDSG) seit September 2023. Hat sie EU-Kunden, gelten DSGVO und AI Act in ihrem Setup parallel.

Wo Paperclip im Werkzeugkasten steht

Damit das Bild rund wird, ein kurzer Blick auf das Ökosystem um Paperclip herum. KI-Werkzeuge lassen sich grob in fünf Schichten denken:

| Ebene | Beispiele | Funktion |

|---|---|---|

| LLMs | GPT, Claude, Gemini | Sprach- und Reasoning-Modelle |

| Coding-Agenten | Claude Code, Codex, Cursor | Arbeiten an Codebases |

| Agent-Frameworks | LangGraph, CrewAI, AutoGen | Multi-Agent-Workflows programmatisch bauen |

| Workflow-Automation | n8n, Zapier, Make | Deterministische Automatisierung |

| Control Plane | Paperclip | Agenten-Teams verwalten |

Paperclip sitzt also nicht im Wettbewerb mit den LLMs oder den Coding-Agenten, es sitzt eine Schicht darüber. Nicht Code, sondern UI. Nicht Pipeline, sondern Org-Chart. Nicht Workflow, sondern Verantwortung. Das ist der Anspruch.

Ob diese Schicht sich als eigene Kategorie etabliert oder von den großen Cloud-Anbietern absorbiert wird, ist eine offene Frage. Microsofts Agent Framework schiebt sich in dieselbe Richtung, mit dem Vorteil hauseigener Telemetrie und Enterprise-Integration. Open-Source-Werkzeuge wie Paperclip stehen damit unter dem typischen Druck der Software-Geschichte: Sie müssen schneller, neugieriger und schöner sein als das, was ein Konzern in zwei Jahren nachbaut.

Hype gegen Realität: Eine Bilanz

Wer Paperclip-Marketing liest, bekommt fünf Versprechen serviert. Die ehrliche Einordnung sieht so aus.

Das Versprechen „Zero Human Company“ ist eher Zielbild als Realität. Strategie, Qualitätssicherung, Haftung, Freigaben, alles Stellen, an denen Menschen weiter notwendig sind. Paperclip macht ihre Arbeit anders, nicht überflüssig.

„KI-CEO führt die Firma“ auch hier: nicht im Mai 2026. Der Mensch bleibt Strategie- und Haftungsinstanz. Was Paperclip ändert: Der Mensch tut weniger Operatives, mehr Aufsicht.

„Agenten arbeiten autonom“ nur innerhalb der Rechte, Budgets und Tools, die ihnen ein Mensch eingeräumt hat. Autonomie ist hier ein eingerahmter Begriff.

„Open Source löst Datenschutz“ hilft, ersetzt aber keine DSGVO-Prüfung. Selbsthosting ist eine Voraussetzung für Datenschutzkonzepte, kein Datenschutzkonzept.

„Mehr Agenten gleich mehr Produktivität“ nur bei sinnvoller Parallelisierung. Sonst zahlt man die Coordination Tax. Lena hat die Rechnung schon einmal gesehen.

Was Paperclip wirklich ist

Wenn man eine Weile mit der Idee von Paperclip gelebt, die Doku gelesen, die Roadmap durchgekaut und die Risiken sortiert hat, bleibt eine Erkenntnis hängen: Paperclip ist nicht das Tool, das den Menschen ersetzt. Es ist das Tool, das ihm ein Cockpit baut, in dem er noch Pilot bleibt, während unter ihm immer mehr Dinge automatisch laufen.

Das ist weniger sexy als „Zero Human Company“, aber wahrscheinlich nützlicher. Und es passt zur Geschichte des Software-Engineering insgesamt: Die wichtigsten Fortschritte der letzten zwanzig Jahre waren selten Werkzeuge, die alles automatisierten. Es waren Werkzeuge, die Menschen einen Überblick darüber gaben, was die Maschinen taten. Versionskontrolle. Continuous Integration. Beobachtbarkeit. Paperclip steht in dieser Tradition. Es ist Beobachtbarkeit für Agenten-Teams.

Ob die Vision der „Zero Human Company“ jemals technische Realität wird, ist eine andere Frage. Die wichtigere Frage für Leser von foundic.org lautet kürzer: Wer mehrere KI-Agenten betreibt, braucht früher oder später eine Steuerungsebene. Paperclip ist eine plausible Antwort darauf. Nicht die einzige. Nicht alternativlos. Aber eine, die sich anschauen lohnt, mit dem nüchternen Blick, der zwischen „Werkzeug“ und „Heilsversprechen“ zu unterscheiden weiß.

Der Punkt, an dem es offen bleibt

Lena hat ihr Wochenende überlebt. Sie hat die Anthropic-Rechnung geschluckt, die Loops gestoppt, drei Tage mit der Paperclip-Doku verbracht und sich entschieden, ihre Agenten in einer Test-Instanz neu aufzusetzen mit Budgets, mit Approval Gates, mit weniger Hektik. Was sie noch nicht weiß: Ob das Werkzeug ihr nur ein besseres Cockpit gibt oder ob sie auf dem Weg ist, langsam, fast unmerklich, immer mehr Entscheidungen an dieses Cockpit abzugeben.

Genau das ist die Frage, die Paperclip stellt, ob seine Macher es so wollten oder nicht. Wer einen Agenten managt, behält den Überblick. Wer zehn managt, braucht Werkzeuge wie Paperclip. Wer hundert managt, sitzt nicht mehr am Steuer, sondern beobachtet das Steuer beim Lenken.

Der Punkt, an dem Beobachtung in Verwaltung übergeht, ist nicht hart. Er ist weich, gleitend, schleichend. Und er ist die eigentliche Frage, die Bostroms Büroklammern schon 2003 gestellt haben: Nicht ob die KI uns ersetzt, sondern ab welchem Punkt wir aufhören, die zu sein, die entscheiden.

Wer Paperclip einsetzt, sollte diese Frage offen halten. Es wäre die wichtigste Funktion, die das Tool selbst nicht eingebaut hat.