Worum geht’s?

Unternehmen, die große KI-Modelle betreiben, stehen häufig vor dem Problem ineffizienter GPU-Auslastung. Ein innovativer Architekturansatz namens Disaggregated Inference könnte diese Herausforderung lösen: Durch die Aufteilung der Inferenzarbeit auf zwei spezialisierte GPU-Pools lässt sich die Ressourcennutzung erheblich verbessern. Ein Praxisbeispiel zeigt, wie ein großer Einzelhändler mit einem 70-Milliarden-Parameter-Modell für Produktsuchen durch diese Umstellung jährlich zwischen 600.000 und 800.000 Dollar einsparen konnte.

Hintergrund & Einordnung

Die Ineffizienz herkömmlicher GPU-Infrastrukturen für KI-Inferenz resultiert aus der bimodalen Natur des Workloads. Während die Prompt-Verarbeitung – also das Einlesen und Verstehen der Anfrage – rechenintensiv ist und die GPU stark beansprucht, erfordert die anschließende Token-Generierung deutlich weniger Rechenleistung, ist aber speicherintensiv. Bei monolithischen Ansätzen führt dies zu erheblicher Unterauslastung: Die GPU läuft während der Generierungsphase praktisch im Leerlauf, obwohl sie belegt bleibt.

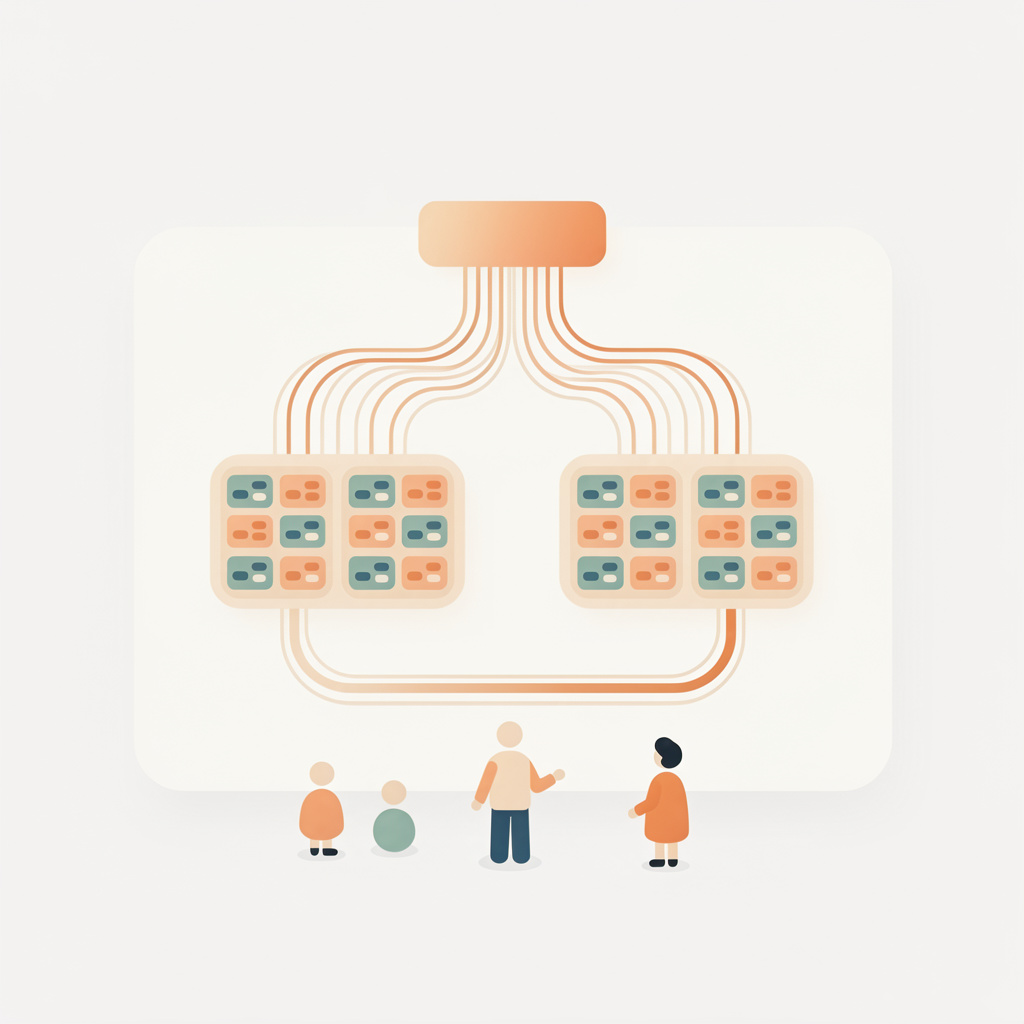

Analysen der GPU-Nutzung zeigen diese Diskrepanz deutlich: Während der Prompt-Phase herrscht Spitzenauslastung, in der Generierungsphase sinkt die tatsächliche Rechenaktivität drastisch. Dies erklärt, warum hohe GPU-Stundenzahlen nicht automatisch effiziente Ressourcennutzung bedeuten. Disaggregated Inference adressiert dieses Problem durch Trennung der Arbeitslast: Ein Pool übernimmt die pulsierende Prompt-Verarbeitung, ein zweiter die kontinuierliche Token-Generierung.

Die technische Umsetzung erfolgt über einen intelligenten Routing-Layer, der eingehende Anfragen analysiert und an den jeweils passenden Pool weiterleitet. Orchestrierungs-Frameworks wie NVIDIAs Dynamo unterstützen diese Architektur. Der Ansatz passt in einen größeren Trend: Mit zunehmender Verbreitung von KI-Anwendungen rückt die Infrastruktur-Effizienz stärker in den Fokus, wie auch NVIDIAs jüngste Blackwell-Generation zeigt, die explizit auf Effizienzsteigerungen setzt.

Was bedeutet das?

- Kostenoptimierung: Unternehmen können ihre GPU-Kosten für KI-Inferenz signifikant senken, ohne die Leistung zu beeinträchtigen – in Praxisfällen um mehrere Hunderttausend Dollar jährlich.

- Verbesserte Nutzererfahrung: Die Architektur führt zu gleichmäßigeren Token-Raten und stabilerer Antwortqualität, was sich direkt in der Anwendungsperformance niederschlägt.

- Skalierbarkeit: Die Trennung ermöglicht es, jeden Pool unabhängig zu skalieren und optimal auf seine spezifische Aufgabe auszurichten – ein wichtiger Vorteil für wachsende KI-Workloads.

- Infrastruktur-Planung: Für die Jahre 2025 bis 2030 wird GPU-Kapazitätsplanung zunehmend strategisch relevant. Disaggregated Inference bietet einen Weg, bestehende Ressourcen besser auszunutzen, bevor zusätzliche Hardware angeschafft wird.

- Breitere Anwendbarkeit: Der Ansatz ist besonders relevant für Unternehmen mit hohen Inferenzvolumen, könnte aber auch kleineren Organisationen helfen, ihre Cloud-GPU-Kosten zu kontrollieren.

Quellen

GPU-Effizienz verdoppeln – ohne Zusatzkosten (Computerwoche)

NVIDIA setzt mit Blackwell auf Effizienz statt reine Rechenkraft

AI Infrastructure Capacity Planning und GPU-Forecasting 2025-2030

GPU für KI-Workloads (Google Cloud)

Dieser Artikel wurde mit KI erstellt und basiert auf den angegebenen Quellen sowie den Trainingsdaten des Sprachmodells.

Weiterführender Artikel: Vom Textgenerator zum digitalen Mitarbeiter / KI Agenten – Wie KI in vier Stufen die Welt verändert